La recherche en ligne a muté. Pendant deux décennies, le contrat était simple : vous produisiez du contenu optimisé, Google l'indexait, l'utilisateur cliquait sur le premier résultat. Ce modèle est en phase terminale.

Aujourd'hui, une complication majeure bouleverse l'acquisition client : les utilisateurs ne cherchent plus des liens, ils exigent des réponses immédiates. Selon Gartner, le volume de recherche classique chutera de 25 % d'ici 2026 à cause des chatbots et agents virtuels. La conséquence pour votre entreprise ? Une chute brutale du trafic organique, car l'utilisateur obtient sa réponse directement dans l'interface de l'IA, sans jamais visiter votre site.

La question n'est plus de savoir comment se positionner en haut de la page 1 de Google, mais comment entrer dans la mémoire de l'intelligence artificielle. Comment être visible sur ChatGPT, Perplexity ou Gemini quand ces outils filtrent 99 % du bruit d'internet ?

La réponse tient en un changement de paradigme fondamental. Vous devez cesser de faire du seo traditionnel pour embrasser le Generative Engine Optimization (GEO). Il ne s'agit plus de concevoir des pages vitrines, mais de structurer un actif numérique de haute valeur, conçu comme une base de données irréfutable pour les IA génératives. Voici l'architecture exacte pour y parvenir.

framerusercontent.com/images/8hUHUG5ttMyqQZx9LTq4nYrU8.webp">

La nouvelle ère du search : Du SEO traditionnel au Generative Engine Optimization (GEO) pour votre visibilité

Ce qui fonctionnait en 2023 est obsolète. L'écosystème éditorial s'est transformé. Comprendre cette mécanique n'est pas une simple tendance, c'est une nécessité stratégique pour protéger les leviers de croissance de votre marque.

La fin du monopole du clic et l'avènement de la citation Dans le modèle du seo pour google, le taux de clic (CTR) était la métrique reine pour générer une simple liste de liens. L'objectif était d'optimiser une balise title pour capter l'attention. En revanche, dans cette nouvelle ère, le clic disparaît au profit de la citation directe par un moteur de réponses.

Le nouveau critère de performance, c'est la probabilité que votre domaine soit utilisé comme source de confiance par l'algorithme. Si ChatGPT ou Bing Copilot vous citent, vous gagnez en autorité. S'ils vous ignorent, vous n'existez tout simplement pas dans la nouvelle façon dont vos futurs clients s'informent.

Comment fonctionne le cerveau des IA pour vous rendre visible sur chatgpt

Pour comprendre comment être visible sur ces nouveaux outils, il faut comprendre comment ils lisent le web. Les modèles récents utilisent une architecture appelée RAG (Retrieval-Augmented Generation). Votre visibilité en ligne dépend désormais de la qualité des contenus que ces algorithmes peuvent extraire instantanément de votre écosystème.

L'impact chiffré sur l'acquisition et le trafic

L'impact de ce phénomène est direct sur vos résultats financiers. Concrètement, cette évolution se traduit par :

Des requêtes conversationnelles : Les mots-clés courts ("agence seo") sont remplacés par des prompts complexes ("quelle agence peut restructurer mon site pour l'IA dans le domaine médical ?").

Un filtrage drastique : Sur Google, il y a 10 places sur la première page. Sur ChatGPT, il n'y a qu'une à trois citations par réponse.

Un trafic hyper-qualifié : Les visiteurs qui cliquent sur une source depuis ChatGPT ont déjà lu le résumé de votre expertise. Leur intention de recherche est comblée, leur niveau de maturité est plus élevé. Ce trafic convertit mieux.

Pourquoi le SEO classique ne suffit plus en pleine révolution

Ce que ChatGPT ignore largement, ce sont les vieilles ficelles du SEO. Le bourrage de mots-clés ne sert à rien face à un modèle qui comprend la sémantique pure. Les liens internes excessifs ou le contenu reformulé sans valeur ajoutée sont écartés. L'IA cherche des entités, du contexte et des preuves. Si votre stratégie de création de contenu se limite à publier des articles de blog génériques, votre visibilité s'effondrera. Vous devez construire des réponses, pas seulement des textes.

L'Infrastructure Technique : Le socle et les leviers pour ouvrir votre site aux IA

Le meilleur contenu du monde ne générera aucune audience s'il est techniquement invisible. Le contenu seul ne suffit plus. Votre site web doit envoyer les bons signaux d'indexation aux robots : ceux de Google, bien sûr, mais surtout ceux d'OpenAI, de Claude et des autres moteurs de recherche génératifs. C'est ici que la majorité des entreprises échouent. Elles accumulent de la dette technique qui bloque littéralement l'accès à l'information (mauvaise vitesse de chargement, navigation complexe, code surchargé).

Voici la checklist technique, l'audit GEO fondamental que j'applique pour transformer un site vitrine en véritable base de données lisible par l'IA.

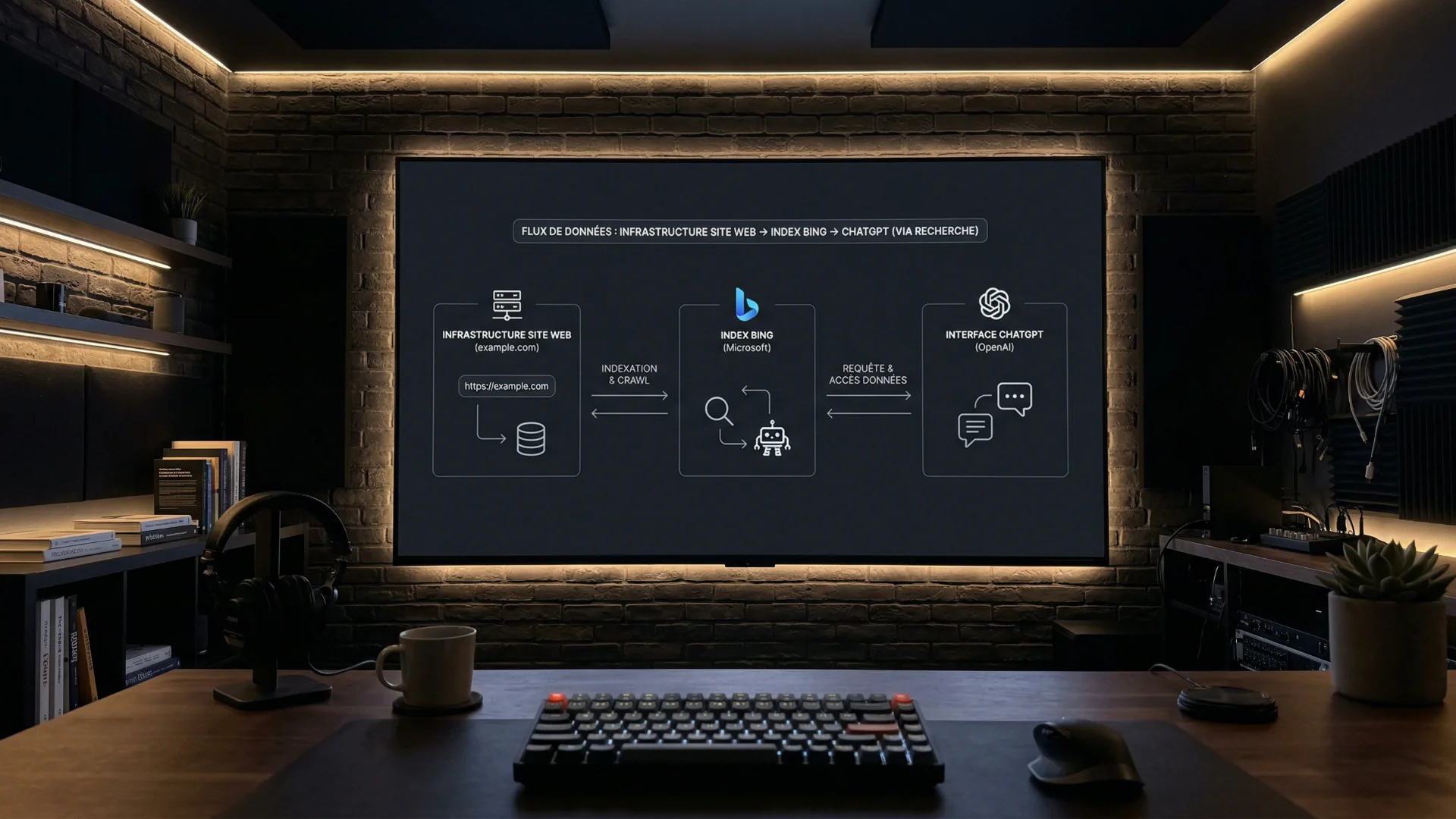

Le point aveugle de 90 % des entreprises : L'index Bing

C'est l'erreur la plus coûteuse de cette décennie. La quasi-totalité des stratégies de création de contenu sont historiquement calibrées exclusivement pour Google. Or, pour répondre aux requêtes en temps réel de ses utilisateurs, ChatGPT Search tire ses résultats directement de l'index de Bing (Microsoft étant le principal investisseur d'OpenAI).

Ignorer Bing aujourd'hui, c'est refuser d'être visible sur ChatGPT.

Plan d'action immédiat pour votre domaine :

Bing Webmaster Tools : Créez un compte et soumettez immédiatement votre sitemap XML. N'attendez pas que le moteur de recherche vous trouve par hasard.

Vérification de l'indexation : Utilisez la Search Console de Bing. Des pages stratégiques parfaitement indexées sur Google peuvent être totalement absentes de Bing. Corrigez ces anomalies manuellement.

Configuration critique du fichier robots.txt

Le fichier robots.txt est la porte d'entrée de votre serveur. Par mesure de sécurité obsolète ou par négligence, de nombreuses agences bloquent l'accès aux nouveaux robots d'exploration. Bloquer ces bots revient à vous rendre volontairement invisible aux yeux de l'IA.

Vérifiez immédiatement (ou demandez à votre développeur) que votre fichier n'interdit pas l'accès aux User-agents suivants :

OAI-SearchBot(le robot d'OpenAI dédié à la recherche en temps réel).GPTBot(le robot d'entraînement général d'OpenAI).bingbot(le robot de Microsoft).ClaudeBot(pour le modèle d'Anthropic).

Si vous leur fermez la porte, vos concurrents prendront votre place dans les réponses générées.

Le fichier LLMs.txt : Le résumé parfait pour les modèles de langage

Si le robots.txt indique aux bots où ils ne doivent pas aller, le fichier llms.txt leur indique exactement ce qu'ils doivent retenir. C'est le nouveau standard technique de l'ère GEO.

L'erreur commune est de laisser l'IA scanner un site web complexe, en espérant qu'elle y trouve un sommaire clair de votre activité. L'approche d'un architecte web est différente : on mâche le travail de l'IA. Le fichier llms.txt agit comme un condensé ultra-structuré de votre entreprise. Il livre à l'IA votre proposition de valeur avec une clarté absolue dans son langage natif : le texte brut.

Le fichier llms.txt (souvent accompagné de versions Markdown de vos pages) agit comme un condensé ultra-structuré de votre entreprise. Il livre à l'IA votre proposition de valeur, vos offres et votre documentation dans son langage natif : le texte brut. En déployant ce fichier sur les architectures que je construis, je garantis que les modèles d'OpenAI ou d'Anthropic ingèrent l'exacte vérité sur votre marque, sans déperdition d'information ni hallucination. C'est un avantage concurrentiel massif, car 99% de vos concurrents ignorent encore l'existence de ce protocole.

Schema.org et Données Structurées : Transformer votre site en base de données

L'IA ne "voit" pas votre design. Elle lit vos données. Si votre site n'est qu'une succession de paragraphes esthétiques, l'algorithme doit deviner de quoi vous parlez. L'intelligence artificielle déteste l'incertitude : si elle doute, elle ne vous cite pas.

Le balisage Schema.org (via le format JSON-LD) est la solution. C'est une sur-couche de code invisible pour le visiteur, mais vitale pour les machines. Il permet d'étiqueter chaque élément de votre actif numérique :

Ceci n'est pas juste un texte, c'est une "Organisation" nommée X, fondée par Y.

Ceci n'est pas une simple page, c'est un "Article" rédigé par un expert identifié.

Ceci n'est pas une liste, c'est une "FAQ" avec des questions et des réponses définitives.

Ces balises agissent comme des étiquettes sémantiques. Vous devez intégrer :

Article Schema : Pour identifier clairement l'auteur, la date de mise à jour et la source de l'article. L'IA valorise la fraîcheur et la paternité du contenu.

FAQPage : Si vous répondez à des questions spécifiques, balisez-les. L'IA adore extraire des réponses précises de ce format pour construire ses propres listes de résultats.

LocalBusiness / Organization : Pour lier mathématiquement votre marque à son adresse physique, ses dirigeants et son secteur d'activité.

En structurant vos données avec ce niveau de granularité, vous ne laissez plus la place à l'interprétation. Vous imposez votre entité aux algorithmes de RAG (Retrieval-Augmented Generation). C'est ce niveau de rigueur technique qui transforme un simple site vitrine en une machine de conversion Future-Proof.

La vitesse et la propreté du code (Zéro dette technique)

L'IA alloue un "budget de crawl" très limité lorsqu'elle parcourt le web en temps réel pour formuler une réponse. Si votre site met 6 secondes à charger à cause d'un thème WordPress surchargé et de plugins inutiles, l'IA abandonnera la requête avant même de lire votre texte.

C'est exactement pour cette raison que je construis exclusivement les actifs numériques de mes clients sur des technologies comme Framer. Vous avez besoin d'une architecture ultra-rapide, propre, sans dette technique. Une performance d'affichage instantanée garantit que le bot d'OpenAI pourra aspirer vos données dans les millisecondes qui lui sont imparties pour formuler sa réponse à l'utilisateur.

Architecture du contenu : Rédiger à haute valeur ajoutée pour les modèles de langage

Avoir une infrastructure technique irréprochable ne suffit pas si votre contenu est creux. L'IA ne lit pas votre site pour se divertir, elle l'explore pour extraire des informations précises afin de résoudre le problème d'un utilisateur.

Les anciennes stratégies de contenu basées sur la production de masse de petits articles de 500 mots sont mortes. Les créateurs de contenu qui continuent de publier des textes généralistes, sans angle ni données, verront leur trafic s'effondrer. Pour exister, vous devez transformer chaque page en une ressource incontestable. Voici comment structurer l'information.

Profondeur vs Superficialité : La règle du guide exhaustif

L'intelligence artificielle déteste la fragmentation. Si un LLM (Large Language Model) doit visiter dix pages différentes de votre site pour rassembler une réponse complète, il ira chercher une source unique chez votre concurrent.

Ne produisez pas dix articles superficiels sur des sous-thématiques. Produisez un guide complet, monolithique et exhaustif (2 000 mots minimum) sur un sujet hautement spécialisé. Les IA favorisent les pages qui couvrent un sujet dans sa totalité, car elles y trouvent tout le contexte sémantique nécessaire pour générer une réponse riche. C'est ce que je construis pour mes clients : moins de pages, mais des pages qui agissent comme des piliers d'autorité absolus sur leur marché.

Le langage naturel et la sémantique : Écrire pour la compréhension des IA

L'un des mythes tenaces du SEO classique est qu'il faut répéter inlassablement un mot-clé précis pour être compris. C'est faux. Ce que ChatGPT ignore largement, c'est le bourrage de mots-clés. Le modèle comprend le sens mathématique des mots (vecteurs sémantiques), pas leur densité brute.

Rédigez comme un expert qui s'adresse à un pair. Écrivez pour la compréhension, pas pour l'algorithme d'il y a dix ans. L'IA analyse les entités nommées (personnes, lieux, concepts), les synonymes et le champ lexical global. Si votre contenu dit tout sans rien dire, ou s'il s'agit d'un contenu dupliqué ou reformulé sans valeur ajoutée, l'IA passe son chemin. Chaque phrase doit faire avancer le raisonnement. Le minimalisme et la précision sont vos meilleures armes.

L'importance d'utiliser des exemples concrets et des sources fiables

Un LLM calcule une probabilité de vérité. Si votre article affirme un fait sans le prouver, il n'a aucune chance d'être cité. L'IA a besoin de s'appuyer sur du tangible pour justifier ses propres réponses.

Vous devez impérativement intégrer des données chiffrées, des études de marché récentes, et surtout des preuves tangibles de votre expertise. L'utilisation d'exemples concrets et de retours d'expérience uniques (que l'IA ne peut pas deviner ou inventer) est ce qui différenciera votre contenu d'une bouillie générée automatiquement. N'hésitez pas à inclure la transcription textuelle d'une vidéo explicative que vous auriez produite : ce format regorge de langage naturel spontané et d'expertise humaine que les modèles adorent ingérer.

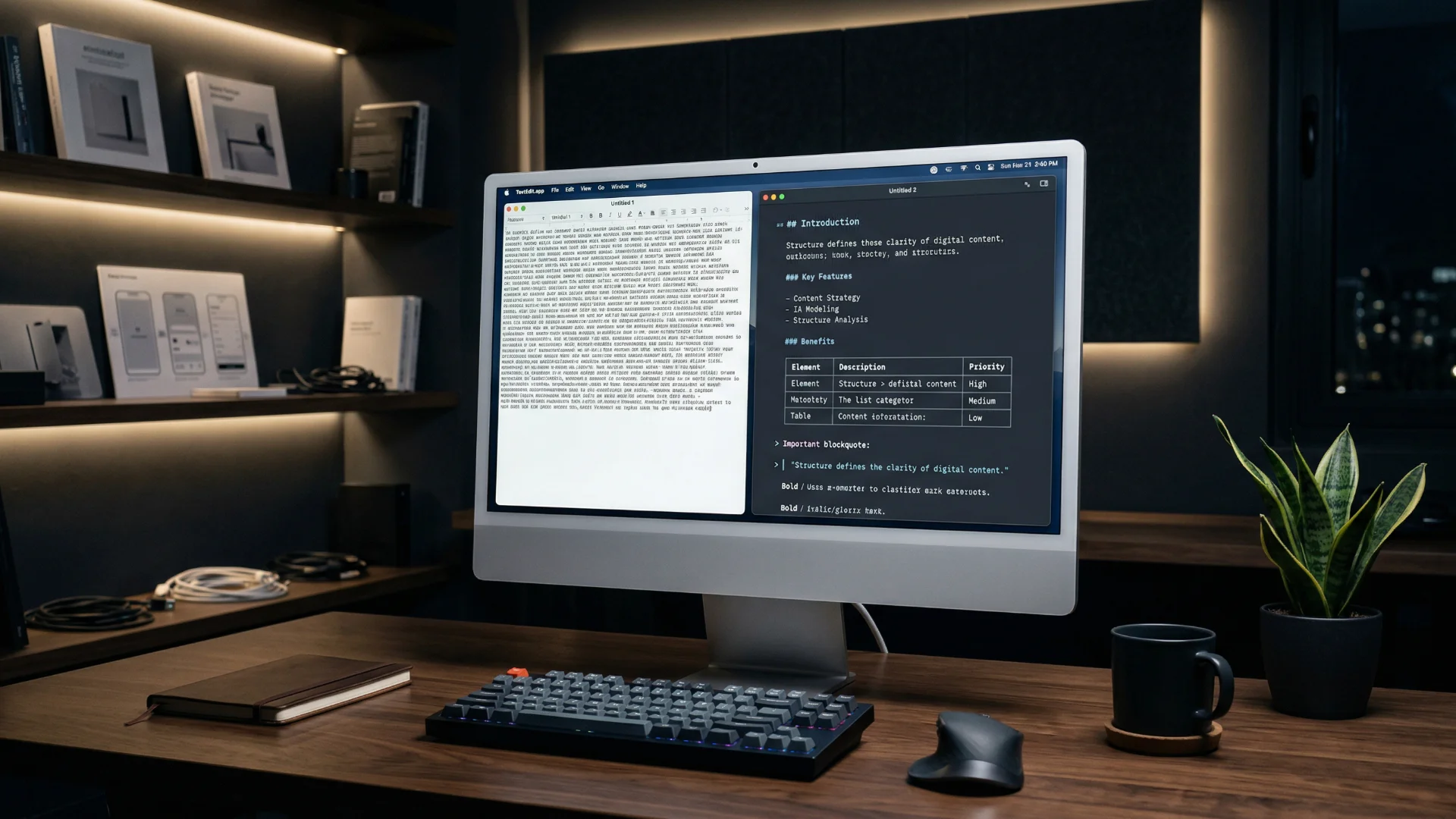

Formats structurés : De l'article expert à la vidéo optimisée

L'IA est un programme informatique. Elle extrait l'information beaucoup plus facilement si la forme de celle-ci est formatée logiquement. Utilisez abondamment le Markdown, et n'hésitez pas à lier une vidéo retranscrite textuellement ou un article de fond hyper-structuré pour nourrir les bases de données des LLMs.

Si vous facilitez l'extraction de la donnée, vous augmentez la probabilité que votre structure soit reprise telle quelle dans les réponses de chatgpt, accompagnée d'un lien vers votre site en tant que source de référence.

Format | Pourquoi l'IA le valorise | L'objectif business |

|---|---|---|

Guide complet | Couvre un sujet en profondeur avec un contexte sémantique riche. | Positionner la marque comme leader d'opinion. |

FAQ structurée | Répond directement à des questions précises (idéal pour le balisage schema.org). | Capter les requêtes de longue traîne conversationnelles. |

Étude de cas | Fournit des données concrètes, des preuves et des KPIs vérifiables. | Rassurer l'IA sur l'authenticité de votre expertise. |

Comparatif | Synthétise des informations complexes (ex: "Outil A vs Outil B"). | Intercepter l'utilisateur au moment de sa décision d'achat. |

Article blog expert | Démontre l'expertise sectorielle via une analyse propriétaire (pas de redite). | Obtenir des backlinks organiques et des citations. |

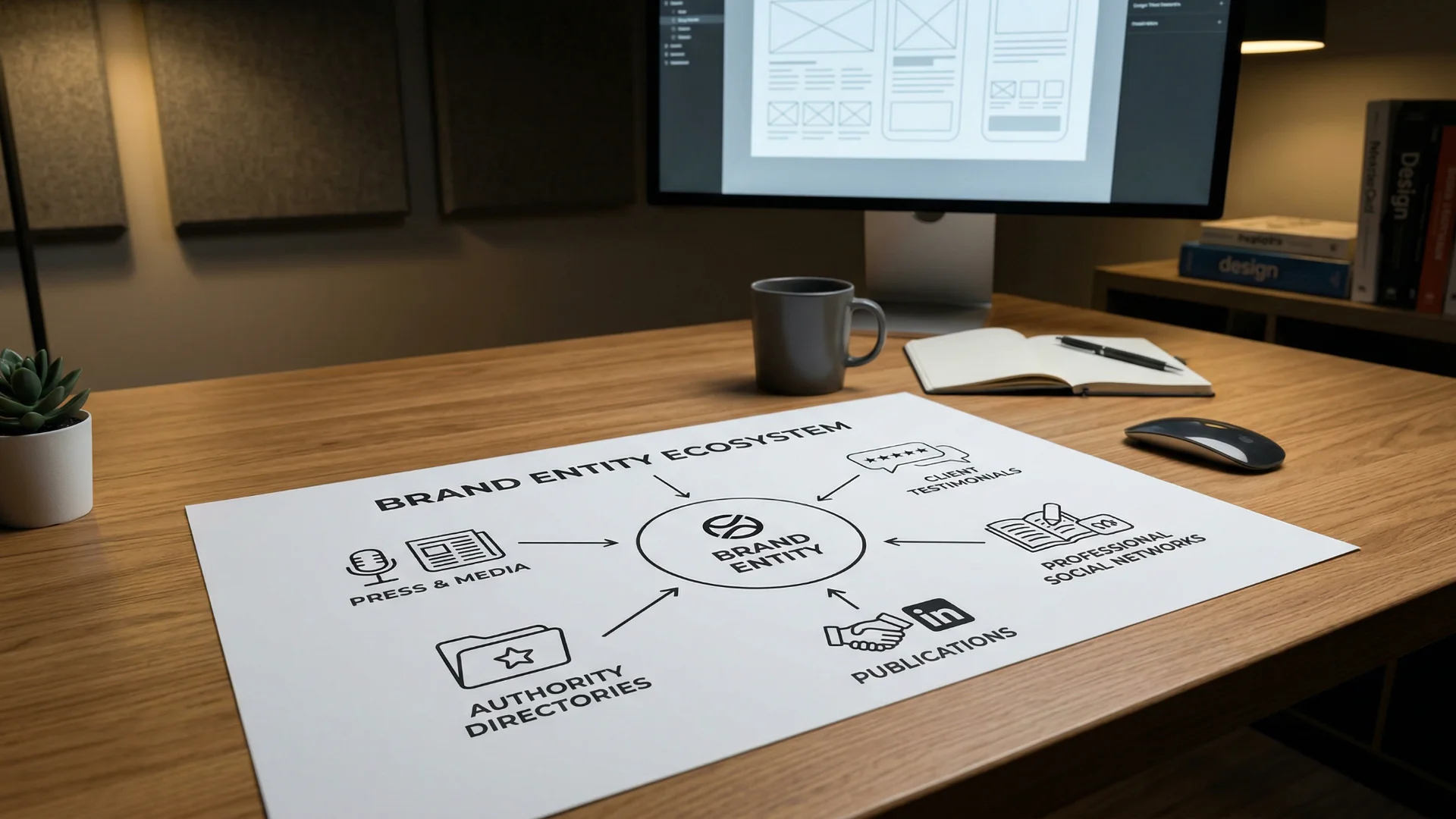

Bâtir votre crédibilité : Les médias et l'étude de votre empreinte numérique

L'IA ne se contente pas de lire votre site. Elle effectue une étude globale de votre empreinte numérique. Pour asseoir votre crédibilité, vous devez exister en dehors de votre propre code. Les algorithmes croisent les données : ils vérifient si vous êtes cité dans les médias reconnus de votre secteur d'activité (comme la santé ou la finance), ou si votre entreprise a une présence physique vérifiée sur un lieu précis via des outils comme Google Maps. Chaque citation externe agit comme un signal de confiance irréfutable pour le modèle.

Autorité et Écosystème Éditorial : Devenir l'entité de référence de son marché

Avoir un site techniquement parfait et un contenu profond ne suffit pas si personne ne vous connaît. Les modèles de langage comme ChatGPT fonctionnent sur un principe de consensus mathématique. Si une information n'existe que sur votre site, elle est considérée comme une simple affirmation. Si cette même information est corroborée par des dizaines de sources externes d'autorité, elle devient un fait avéré.

Pour exister dans les réponses de l'IA, vous devez prouver votre légitimité. C'est ici qu'intervient le framework E-E-A-T (Expérience, Expertise, Autorité, Confiance), historiquement utilisé par Google, mais désormais massivement adopté par les LLM pour filtrer le bruit.

Le framework E-E-A-T appliqué aux IA génératives

L'intelligence artificielle ne veut pas prendre le risque de recommander une entreprise incompétente. Elle cherche des signaux de confiance forts.

Expérience & Expertise : L'IA analyse qui rédige le contenu. Vous devez lier mathématiquement vos articles à des profils d'auteurs réels et reconnus dans votre secteur. Fini les articles signés "L'équipe". Je structure les sites de mes clients avec des pages auteurs détaillées (bio, diplômes, liens LinkedIn), balisées techniquement pour que l'IA comprenne immédiatement qu'elle lit les mots d'un véritable expert, pas d'un stagiaire.

Autorité & Confiance : L'IA vérifie si votre domaine est une référence. Cela passe par la transparence absolue : mentions légales claires, conditions générales de vente accessibles, politique de confidentialité irréprochable et un service client facilement identifiable.

Le poids du Digital PR : Ce que le web dit de vous

ChatGPT ne se contente pas de lire votre site. Il lit ce que le reste d'internet dit de votre marque. C'est le principe des co-occurrences sémantiques. Si votre marque (l'entité) est fréquemment citée à côté de mots-clés de votre expertise sur des sites d'autorité (presse spécialisée, blogs majeurs, institutions), l'IA associe définitivement votre entreprise à cette compétence.

Obtenir des mentions de marque (même sans liens hypertextes) et des backlinks depuis des médias de qualité n'a jamais été aussi stratégique. Une citation dans un média respecté pèse infiniment plus lourd qu'une centaine d'articles de blog publiés sur un site inconnu. Investissez dans des relations publiques numériques (Digital PR) pour faire de votre entreprise un fait incontournable de son secteur.

Contrôler son entité via les annuaires de niche et les plateformes d'avis

Les IA utilisent des bases de données structurées pour vérifier les informations factuelles d'une entreprise (adresses, horaires, notation). Si vos informations sont incohérentes d'un annuaire à l'autre, vous créez de la confusion algorithmique. L'IA, dans le doute, préfèrera ne pas vous citer.

Cohérence NAP (Name, Address, Phone) : Assurez-vous que vos coordonnées sont strictement identiques sur l'ensemble du web.

Plateformes de confiance : Revendiquez et optimisez vos profils sur Google Business Profile, Trustpilot, G2, ou les annuaires syndicaux de votre secteur. Les LLM scannent régulièrement ces bases pour évaluer le sentiment global (positif ou négatif) autour de votre marque avant de la recommander à un utilisateur cherchant "le meilleur prestataire pour...".

5. Mesure et Itération : Piloter votre présence dans les IA génératives

L'intuition n'a pas sa place dans l'acquisition client. Si vous investissez dans la structuration de votre actif numérique pour séduire les modèles de langage, vous devez mesurer le retour sur investissement (ROI) de chaque action. Le GEO (Generative Engine Optimization) n'est pas un mythe abstrait : il génère du trafic qualifié, des clics et des leads. Mais encore faut-il savoir où regarder.

Contrairement à Google Search Console qui offre des données limpides sur les requêtes traditionnelles, le tracking de l'IA demande une approche chirurgicale. Voici comment je monitore la performance des écosystèmes que je déploie.

Isoler le trafic IA dans Google Analytics 4 (GA4)

Lorsqu'un utilisateur clique sur un lien source généré par ChatGPT, ce clic laisse une trace. Par défaut, ce trafic se noie souvent dans la masse des visites "Referral" (sites référents).

Pour piloter votre croissance, vous devez isoler ces signaux. Dans GA4, il faut filtrer vos sources d'acquisition pour traquer spécifiquement les domaines liés à OpenAI. Concrètement, vous cherchez à isoler des sources comme chatgpt.com ou les applications mobiles (android-app://com.openai.chatgpt). Voir ces métriques augmenter mois après mois est la preuve mathématique que votre architecture sémantique fonctionne.

Chaque clic provenant d'une IA est un clic de très haute intention. C'est un utilisateur qui a posé une question complexe à ChatGPT, a lu une réponse complète, puis a cliqué sur votre lien pour aller plus loin ou acheter un service. C'est la quintessence du lead qualifié.

Le proxy absolu : Bing Webmaster Tools

Nous l'avons vu plus haut, ChatGPT Search s'appuie massivement sur l'index de Microsoft. Par conséquent, Bing Webmaster Tools n'est plus un outil secondaire. C'est votre radar principal pour comprendre comment l'IA générative interagit avec votre domaine.

Analysez la fréquence de crawl du bot de Bing, ses erreurs, ses avertissements. Si Bing rencontre des frictions techniques sur votre site (lenteurs, erreurs 404, blocages JavaScript), ChatGPT fera face au même mur. L'objectif est d'atteindre le zéro défaut technique sur cette plateforme. Un site techniquement fluide sur Bing est un site prêt à être aspiré par les modèles d'OpenAI.

L'audit de réputation (Prompt Audit) : Que dit l'IA de votre marque ?

La mesure n'est pas uniquement quantitative, elle est aussi qualitative. Pour piloter votre visibilité, il faut auditer régulièrement ce que les LLM pensent de vous (votre entité).

L'exercice est d'une simplicité redoutable, mais il révèle tout de votre empreinte numérique actuelle. Connectez-vous à ChatGPT et posez des questions de plus en plus complexes sur votre marque :

"Qui est [Nom de l'entreprise] ?"

"Quels sont les avantages de travailler avec [Votre marque] plutôt qu'avec [Concurrent principal] ?"

"Résume-moi la méthodologie de l'agence [Nom de l'entreprise] pour le design web."

Si l'IA hallucine (invente des informations), répond qu'elle ne sait pas, ou pire, vous confond avec un concurrent au nom similaire : c'est que votre architecture d'information externe et interne est défaillante. Vous avez un "content gap" majeur à combler.

L'objectif de mon accompagnement continu (Offre Croissance/Visibilité) est de corriger ces lacunes. Mois après mois, je déploie des dossiers stratégiques et structure des pages piliers pour forcer l'apprentissage de l'IA autour de votre entité. Le SEO et le GEO ne sont pas des tâches isolées que l'on fait une fois : c'est un effet cumulé. Vous construisez un actif qui finit par devenir incontournable, une barrière à l'entrée que vos concurrents ne pourront plus franchir d'ici un à deux ans.

Conclusion : Transformer la recherche IA en canal d'acquisition prédictible

L'intégration de ChatGPT Search et l'essor des LLMs ne signent pas la fin du SEO. Ils marquent la fin de la médiocrité. Les algorithmes d'OpenAI et de Google ne cherchent plus de simples mots-clés : ils cherchent des entités fiables, des architectures techniques irréprochables et des réponses définitives.

Être visible sur ChatGPT n'est pas une question de chance ou d'astuces temporaires. C'est le résultat mathématique d'une stratégie GEO (Generative Engine Optimization) exécutée avec précision. Votre site web ne doit plus être une simple vitrine numérique. Si votre présence en ligne ne génère pas de trafic organique qualifié, ce n'est pas un actif : c'est une dette.

En tant que partenaire stratégique, je ne me contente pas de concevoir des plateformes esthétiques. Je construis des machines de conversion. De la refonte complète sur une architecture Framer Future-Proof (Offre Signature) au déploiement d'une stratégie de domination sémantique mensuelle (Offre Croissance), mon objectif est unique : positionner votre entreprise comme l'unique réponse évidente, que votre prospect interroge Google ou ChatGPT.

Vous avez la vision, j'ai l'expertise technique et stratégique. Ne laissez pas vos concurrents éduquer l'IA à votre place.

Lançons la transformation. Discutons de votre écosystème numérique.

Sources :

Étude Gartner Volume de recherche : ChanelNews

FAQ : Les questions les plus posées sur le référencement ChatGPT

Valentin DUPIN

EXPERT FRAMER & Fondateur du Studio Dislo

Je conçois des actifs numériques pour les entreprises qui veulent dépasser le stade de la simple "présence en ligne". Mon expertise unique fusionne le Design d'élite (Framer) et la Stratégie d'acquisition (SEO/GEO). Je ne livre pas juste des pages web, je livre une infrastructure de croissance.